Get started

MinT

面向 LLM 的 RL 训练基础设施。你写训练循环,我们搞定 GPU。

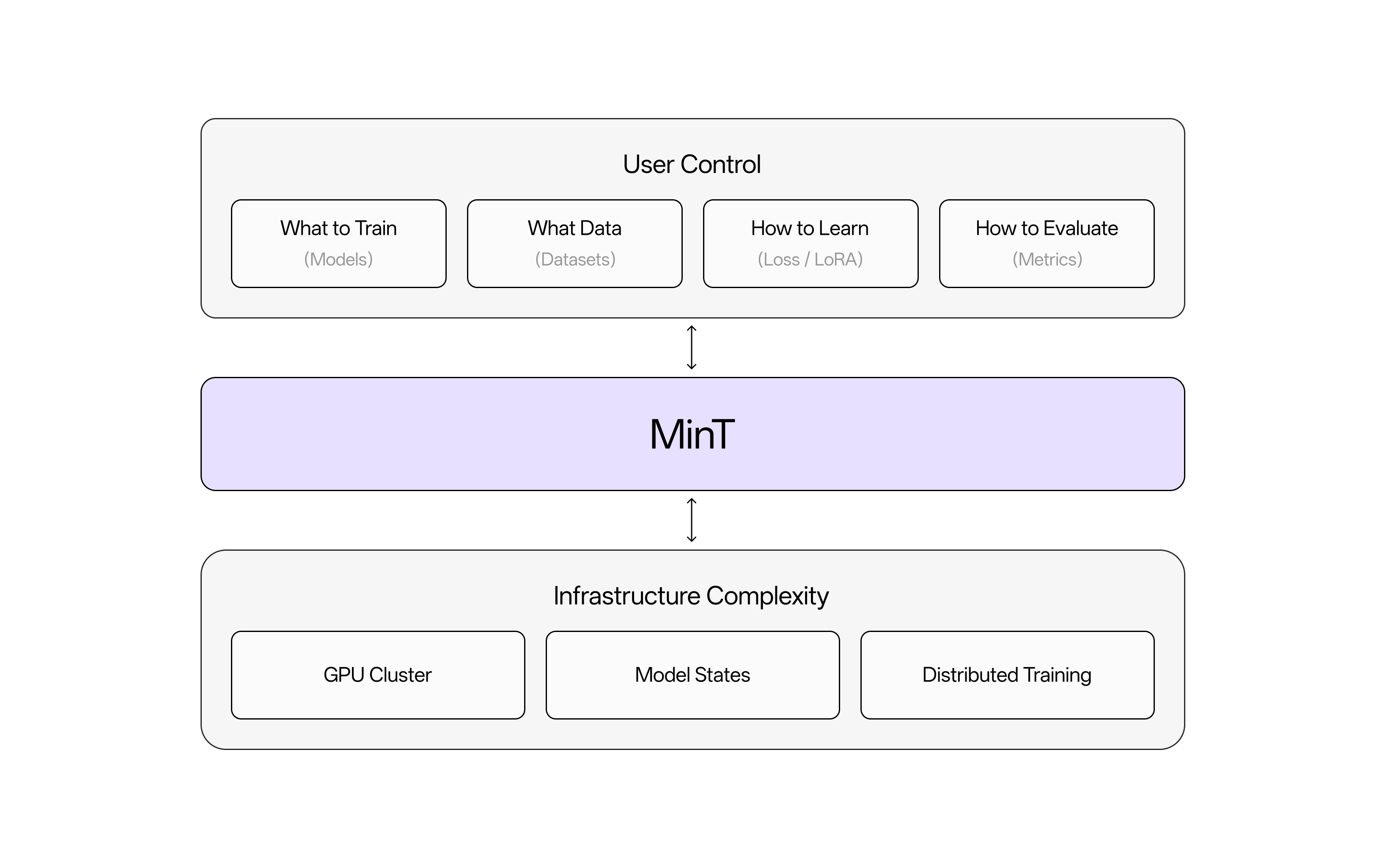

MinT 让你只关注 LLM 后训练里真正重要的事情 —— 你的数据、你的损失函数、你的 RL 环境 —— 而把分布式训练的繁重负担交给我们。你只需要在自己的 CPU 机器上写一个简单的 Python 脚本,里面包含数据或环境以及损失函数。我们会找到一种方式,把训练任务高效地跑在一个 GPU 集群上,做你指定的那一份计算。要换模型,你只需要改代码里的一个字符串。

MinT 把训练循环和算法细节的全部控制权留给你。它不是那种把"微调变简单"的黑盒;它是一层干净的抽象,把分布式训练的复杂性挡在外面,同时保留你对一切的控制。

你的代码通过 MinT SDK 在客户端运行。请求经 API Gateway 到达 MinT 的核心服务 —— Model Router、Task Manager、LoRA Manager —— 由它们协调跨 GPU 集群、对象存储和数据库的分布式训练。你只看见客户端 SDK;服务端的复杂性由我们处理。

Human Quickstart

安装、配置 API key、按 7 步跑通第一次训练。

Prompts for Vibecoders

把 MinT 全部文档索引通过 /llms.txt 喂给 Cursor 或 Claude Code。

想要生产级的 MinT? 查看 MinT 企业版 → 了解托管部署、专属算力、政务/金融/科研定制案例。